Le Forum Économique Mondial (FEM) commence à s’inquiéter un peu. Leurs opinions non approuvées sont de plus en plus populaires, et les censeurs en ligne ne peuvent pas suivre les millions de personnes qui deviennent plus conscientes et plus vocales. Les moteurs de censure employés par les plateformes Internet, se révèlent être assez stupides et incapables. Les gens osent même se plaindre du Forum Economique Mondial, ce qui est évidemment totalement inacceptable.

*Vous

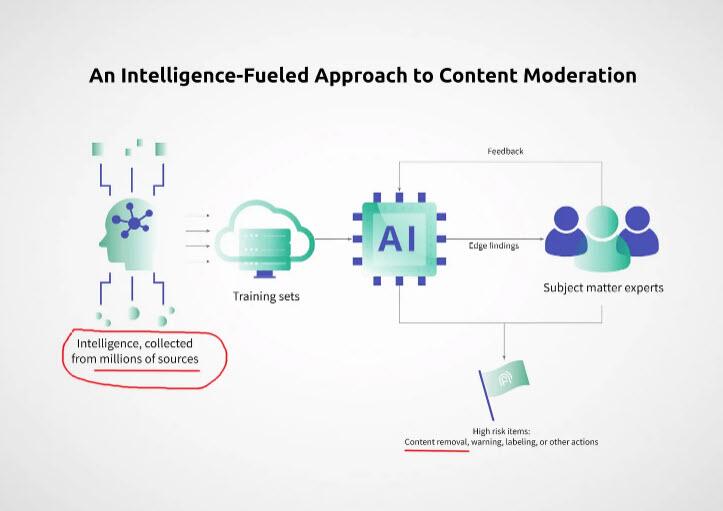

L’auteur du FEM, Inbal Goldberger, a donc trouvé une solution : elle propose de collecter des renseignements hors plateforme à partir de « millions de sources » pour espionner les gens et les nouvelles idées, puis de fusionner ces informations pour les « décisions de suppression de contenu » envoyées aux « plateformes Internet ».

Pour surmonter les obstacles des méthodologies de détection traditionnelles, nous proposons un nouveau cadre : plutôt que de s’appuyer sur l’IA (Intelligence artificielle) pour détecter à grande échelle et sur les humains pour examiner les cas limites, une approche basée sur l’intelligence est cruciale.

En intégrant dans les ensembles d’apprentissage des renseignements provenant de sources humaines, multilingues et hors plateforme, l’IA sera alors en mesure de détecter des abus nuancés et inédits à l’échelle, avant qu’ils n’atteignent les plateformes grand public. En complétant cette détection automatisée plus intelligente par une expertise humaine pour examiner les cas limites et identifier les faux positifs et négatifs, puis en réintégrant ces résultats dans les ensembles d’apprentissage, nous pourrons créer une IA dotée d’une intelligence humaine intégrée. Cette IA plus intelligente devient plus sophistiquée à chaque décision de modération, pour finalement permettre une détection quasi parfaite, à l’échelle.

occupe actuellement le poste de vice-présidente de Trust & Safety chez ActiveFence. Elle a plus de 20 ans d’expérience dans les domaines de la confiance et de la sécurité, du renseignement, de la qualité des produits et de la cybersécurité. Inbal est titulaire d’une licence en linguistique et d’un MBA de l’université de Tel Aviv, où elle s’est spécialisée dans la gestion de l’information. (Source)

De quoi s’agit-il ? Qu’est-ce qui est nouveau ?

De nos jours, la censure est pratiquée de telle sorte que chaque plate-forme Internet, comme Twitter, dispose de sa propre équipe de modération et d’un moteur de prise de décision. Twitter ne regarde que les tweets d’un utilisateur spécifique de Twitter, lorsqu’il décide de supprimer des tweets ou de suspendre leurs auteurs. Les modérateurs de Twitter ne regardent PAS Gettr ou d’autres sites Web externes.

Ainsi, par exemple, l’utilisateur @JohnSmith12345 peut avoir un compte Twitter et respecter scrupuleusement les règles de Twitter, mais avoir en même temps un compte Gettr (WIKI) sur lequel il publierait des messages anti-vaccins. Twitter ne serait pas en mesure de suspendre le compte de @JohnSmith12345. Cela n’est plus acceptable pour le FEM, car il veut faire taire les personnes et les idées, et non les messages ou les comptes individuels.

Cela explique pourquoi le FEM doit aller au-delà des principales plateformes Internet, afin de collecter des renseignements sur les personnes et les idées partout ailleurs. Une telle approche leur permettrait de mieux savoir quelle personne ou idée censurer – sur toutes les grandes plateformes à la fois.

Ils veulent collecter des renseignements à partir de « millions de sources », et entraîner leurs « systèmes d’IA » à détecter les pensées qu’ils n’aiment pas, pour prendre des décisions de suppression de contenu transmises à des sites comme Twitter, Facebook, etc. Il s’agit d’un changement majeur par rapport au statu quo selon lequel chaque plateforme décide de ce qu’elle doit faire en fonction des messages postés sur cette plateforme spécifique uniquement.

Par exemple, en plus de regarder mon profil Twitter, l’IA proposée par le FEM regarderait également mon profil Gettr , puis elle prendrait une « décision intelligente » pour me retirer immédiatement d’Internet. C’est un peu une simplification parce qu’ils veulent aussi chercher des idées et pas seulement des individus mais, néanmoins, la recherche de la mauvaise pensée se mondialise.

*Des renseignements, collectés à partir de millions de sources

*Suppression du contenu

Cela ressemble à une folle théorie de conspiration de l’enfer : Le FME collectant des informations sur tout le monde, partout, et indiquant ensuite à toutes les plateformes quels messages supprimer, sur la base d’un moteur d’IA décisionnel mondial qui voit tout et peut identifier des personnes et des idées individuelles au-delà de toute plateforme donnée.

Si quelqu’un disait un jour que c’était envisageable, je penserais probablement que cette personne est folle. Cela ressemble à un fantasme technologique malsain. Malheureusement, cette folie est réelle, elle se trouve dans une proposition d’ordre du jour du FEM qui est officiellement publiée sur la section « Ordre du jour du FEM » de leur site Web. Et le FEM ne plaisante pas.

Vous n’aurez pas voix au chapitre et vous serez heureux !

Bien sûr, cette modération du contenu de l’IA s’insère directement dans le système de score de crédit social de l’IA. Et si votre score de crédit social (WIKI) tombe en dessous des seuils techno-communistes de l’IA fixés par les élites, toutes sortes de punitions vous seront infligées, de la réduction des crédits UBI (Universal Basic Income – Revenu de base) au rationnement de la nourriture pour insectes, en passant par l’octroi anticipé de la « liberté » d’être euthanasié.

Ne vous conformez PAS.